把脸借给别人是什么感受?卡洛琳·麦金尼斯(Caroline McGinnes)可能是世上为数不多能体会这一感受的人。

本周二,HBO新上线的记录片《欢迎来到车臣》(Welcome to Chechnya)中,卡洛琳·麦金尼斯在影片中“出镜”,但她本人并非参演者,她只是作为志愿者,自愿提供了自己的面孔。

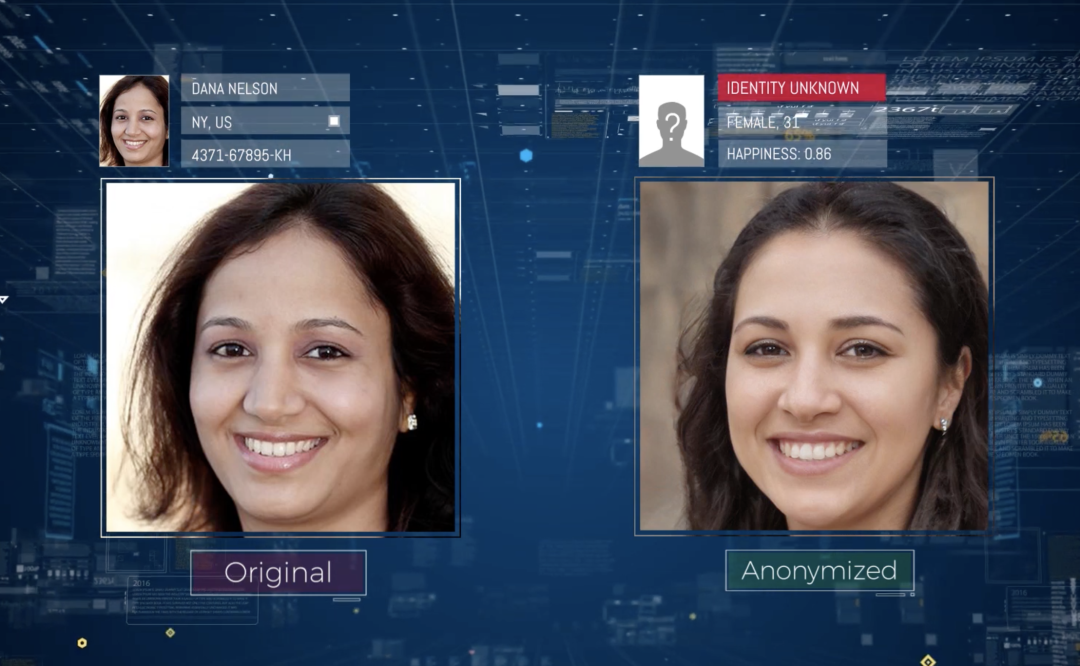

出于对幸存者人身安全的考虑,影片制作团队采用Deepfake换脸技术替换掉了影片中23名匿名幸存者的面孔。

制作团队联系了一批维权人士做志愿者,并与他们签署行动协议,拍摄他们的面部图片,再通过DeepFake技术叠加到影片中幸存者的脸上。

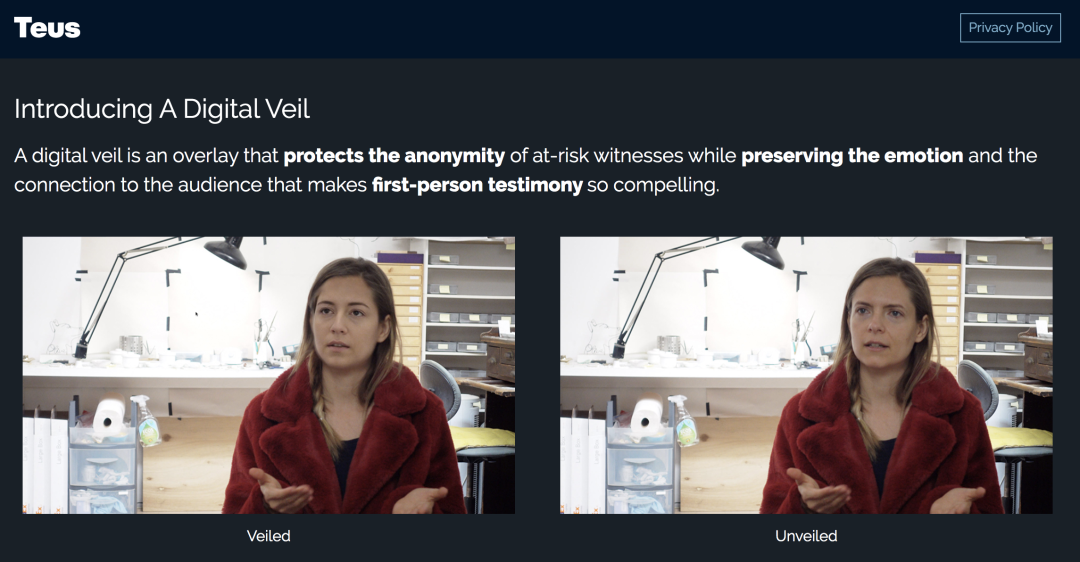

据介绍,相比于传统的匿名方式,例如让受访者坐在阴影下或模糊他们的脸,类似DeepFake的方式在完美掩盖身份的情况下,可以更好的保留受访人的复杂情绪。

不过为了避免引起观看中的混乱感,影片也在一开始的免责声明中指出,某些人物出于安全性目的而被“数字化伪装”。

一张“数字假面”完美隐藏身份

莱恩·兰尼(Ryan Laney),这部影片的视觉特效专家,也是整部影片的“幕后推手”。

据兰尼介绍,纪录片中那些“伪装面孔”的面部动作,是基于DeepFake技术,由原本的真实面部动作来指导两张叠加的面孔进行移动,类似于“提线木偶”。

“我们创造了一个‘数字假面’,这个虚假的面孔可以百分百的保留住原本人物的动作与情感。”整个假面的制作过程主要分为描边、面部修复、虚拟脸颊植入三大步骤,虽然会轻微改变人物眼睛形状,但不会影响眨眼。

不过仔细看的话,在两张面孔叠加的地方有时会显得模糊,眉毛跟眼睛的形状像画笔画出来一样,看上去会有种“超现实”的感觉。

同时为了避免伪造的新面孔出现“恐怖山谷”现象(uncanny valley),制作团队也邀请到达特茅斯大学的社会心理学家和神经科学家塔利亚·惠特利(Thalia Wheatley)的团队来测试不同的换脸方式,并观察飞行观众的反应。

例如,他们尝试过将面部卡通化的方式,类似《蜘蛛侠:平行世界》中的效果,不过表现太差劲。

另外,他们也尝试过保留眼睛部分,将面部其他区域替换的形式,研究人员认为这样可以保证观众与幸存者从眼神中保持情感联系,但并非真正起作用。惠特利推测是因为,将一个人的眼睛放在另一个人的脸上,对观众而言,大脑无法解决不协调的问题,只会感到不安。

“不过,最终的效果要比我们预想的要好。”兰尼在谈到长达一年的后期视觉工作时表示。

《欢迎来到车臣》这部影片于6月30日在HBO和HBO Max上正式亮相,被作为典型的深度伪造品而引发广泛关注。

虽然,DeepFake长期以冒充政治人物、未经许可伪造色情视频而备受争议,但“所有技术都有双重道德目的”,这部影片就证明了,DeepFake可以以正确的方式打开。

利用Deepfake来匿名化

的想法将越来越流行

兰尼表示,类似智能匿名化的想法会越来越流行,他也正在努力推广这项全新的技术应用。

目前,兰尼成立了一家名为Teus Media的公司,并推出一款“数字面纱”产品(digital veil),为新闻报道、记录片、案件陈述等场景中处于危险处境的证人提供匿名保护服务。

当然,兰尼也不是唯一关注这一方向的。

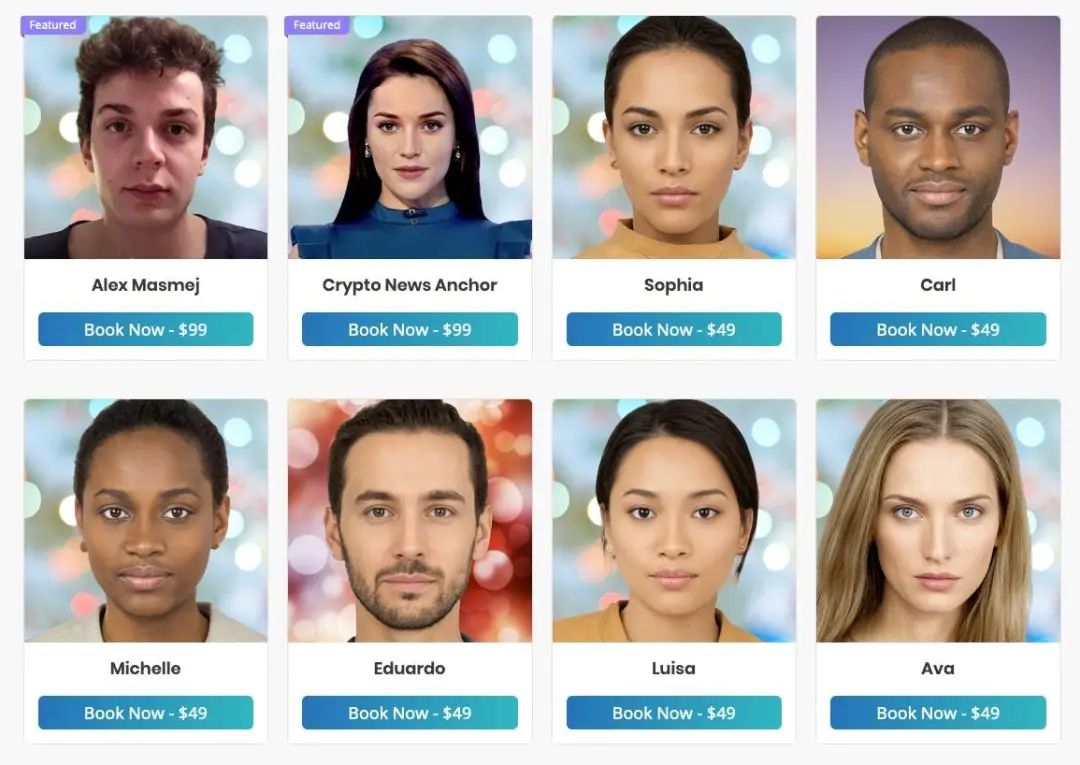

一些新兴公司,比如以色列隐私保护公司D-ID、来自洛杉矶初创团队Alethea AI,已经开始尝试推出数字面罩、Deepfake化身,甚至能够保护隐私的“面部皮肤”,来帮助用户在预先录制好的视频中保护隐私。

一家非营利人权组织的项目主管表示,类似的匿名技术一定程度上能够帮助弱势群体发声甚至说主动维权。

很多时候,在性侵、家暴等事件中,受害人由于不想遭受公众非议而会选择独自忍受,但这个如果有一个足够安全的发声渠道,这些事件就有更多的机会得到曝光。

比如,2016年,一位印度女性曾通过Snapchat的“虚拟面具”功能,讲述了自己遭受性侵的不幸经历。不过与DeepFake不同的是,该功能只是用一些个性化的贴纸来遮挡面部。

视频中,该女性的面部被喷火龙的贴图给遮盖住,唯独露出了眼睛。为了让观众更加真切的感受到当事人的心情,当时报道该事件的印度记者,尽可能给放大了该女性的眼睛。

不过这一功能虽然很好地隐藏了身份,但是当事人的情感因为贴纸的缘故没有办法完全传达出,而且在其实际安全性上,贴纸是否能够被移除仍存在不确定性。

相比之下,利用DeepFake技术生成不存在的,但具备真实感的面部,这样的匿名面孔能够保留原始面孔的关键非识别属性,包括性别、年龄、表情、凝视方向等,无论是人性化,还是安全指数都远远优于依赖遮盖、模糊或像素化的传统方式。

当然,类似的匿名应用也并非没有问题。

比如,在《欢迎来到车臣》这部影片中,两张面孔叠加出的新面孔,在多大程度上应与原本幸存者的身份特征(例如种族、性别和年龄)相匹配,另外,尽管这项技术帮助到了参与影片的受害者,但会不会因此被拿去歪曲和攻击志愿者,这些问题都没有确定的答案。

“可怕”还是“可为”

争论之声从未停止

虽然《欢迎来到车臣》中,DeepFake技术的应用是合理的,但针对其中伦理与监管的争辩却并没有因此停下。

科罗拉多大学丹佛分校国家媒体法证研究中心主任Catalin Grigoras强调,没有人对好莱坞电影中伪造的面孔有任何疑问,只是,一旦它们被用来制造虚假新闻时,问题就会出现。

另外,虽然这样的匿名处理很好的保护了受害者,但志愿者的面部数据在捕获与加工过程中是否会非法流出,导致另一种形式的隐私泄漏?包括从道德层面来看,在DeepFake的技术夹持下,匿名化是否会被过度加工或粉饰,这样的纪录片还可以信任吗?

针对这些质疑,兰尼表示,电影中使用的合成技术既取得了匿名者的同意,同时也获得了自愿提供面部信息的志愿者的同意。包括他也强调,没有人试图欺骗观众,他们是觉得这项技术已足够成熟,并且能够很好的应用到电影中,传达出这些受访人的真实状态。

这一说法正好与Synthesia公司相呼应。Synthesia也是一家出售类似合成媒体技术的初创公司,他们承诺不提供类似Deepfake技术供公众使用,只应用于具有公共利益的商业目的,并承诺不会在“未经他人明确许可的情况下合成他人信息”,其中包括“出于讽刺目的恶搞政客或名人”。

目前,包括相关监管机构与Facebook、Twitter之类的社交媒体公司也试图通过发布法规条例,以限制对DeepFake技术的过度使用。但深度伪造技术作为发展中的产业,其本身也具有广泛的正向应用价值,切不可矫枉过正,应正确引导科技向善。

随着DeepFake技术的日益突出,我们期望有更多正面的、合法的应用案例出现,也期待有更多探讨的声音,在健康的氛围中引导DeepFake从“可怕”走向“可为”。