12月9日,由清华大学人工智能研究院、北京智源人工智能研究院、北京瑞莱智慧科技有限公司联合主办的“2020第三代人工智能产业论坛暨瑞莱智慧RealAI战略发布会”在北京召开。清华大学人工智能研究院院长、中科院院士张钹,清华大学教授、中科院院士王小云,清华大学教授、安全人工智能创新中心主任朱军、北京智源人工智能研究院院长黄铁军,清华大学技术转移研究院院长王燕等数十位特邀嘉宾和人工智能产业数百位业界人士共同出席。

本次会议上,瑞莱智慧RealAI旗下两款新品——隐私保护机器学习平台RealSecure和人工智能安全平台RealSafe2.0 版本正式发布。此次发布,标志着RealAI首次正式展示其基于“第三代人工智能技术”手段所描画的AI原生基础设施蓝图,RealAI将不断深耕人工智能基础设施建设,发展AI产业“第二增长曲线”,致力人工智能成为新时代动力基础。

突破三大“关卡”打造AI原生基础设施

人工智能想要成为新时代的“水和电”,成为驱动各行业升级的底层通用能力,依赖于完备的AI基础设施。RealAI CEO田天表示,继承自互联网时代的经验,当前AI基础设施建设的重心集中在数据中心、算力平台上,主要解决AI“温饱”问题,为AI提供基础运算环境。但随着数据积累受场景限制、现有算力逼近极限,由大数据、大算力等外部驱动力带来的AI产业“第一增长曲线”开始放缓。

瑞莱智慧RealAI CEO 田天

由内打破才是增长。伴随智能化的脚步迈入产业纵深,AI基础设施建设亟需从自身底层能力增强出发,发展出数据和算力维度外的全新能力,以“内生驱动力”打造AI原生基础设施,保证相同的数据、算力条件下,更好的支撑AI赋能行业的深度应用,打开AI产业化全新市场空间,驱动产业第二增长曲线。

想要加强AI内生驱动力需突破三大“关卡”。

第一是算法关,保证算法决策的可靠与安全。田天解释,智能化时代下,AI的决策逻辑和链路天然存在大量不确定性,缺乏可解释性,难以被应用于高价值决策场景。另外,算法普遍存在的“对抗样本”特征导致AI系统存在被恶意攻击的风险。

第二是数据关,保障数据隐私和安全。在训练AI模型时,数据的简单明文传输和利用容易导致隐私泄露。与此同时,为AI应用打破数据孤岛的过程中,数据用途和用量难以保障,可能被滥用和复制,同时难以界定收益,确保所有者的权益。

最后是应用关,即AI应用场景的管控。比如信贷模型中“幸存者偏差”、人脸识别的种族歧视等一系列算法公平性问题的出现,以及技术滥用引发金融欺诈,甚至是政治宣传引导舆论等等。

要突破“三大关卡”,AI原生基础设施需要实现三大块能力,分别是算法可靠、数据安全和应用可控,以实现对现有AI平台升级赋能,拓展AI在各类场景上的可用性。田天认为,这是现阶段人工智能产业需求,也是产业目标。从能力实现来看,这三项能力是完全区别于数据、算力所带来的能力提升,将原本二维的能力增长拓展到全新空间,打开全新维度的能力增长。

始于底层技术栈勾画AI基础设施建设蓝图

打造AI原生基础设施是一个“高目标”,第三代人工智能技术框架则为其提供了实现可能性。

作为孵化自清华人工智能研究院、以技术为本的企业,RealAI深耕安全、可靠、可信和可扩展的第三代人工智能,依托贝叶斯深度学习、可解释机器学习、AI安全对抗攻防、新一代知识图谱、隐私保护机器学习等底层技术栈,围绕算法可靠、数据安全和应用可控三方面打造出AI基础设施建设蓝图,其中包括可解释机器学习建模平台RealBox、人工智能安全平台RealSafe以及深度伪造检测工具DeepReal等一系列平台产品。

本次战略发布会上,RealAI重点发布了两款产品:隐私保护机器学习平台RealSecure和人工智能安全平台RealSafe2.0 版本。

业内首个“编译级”隐私保护机器学习平台

为解决AI应用过程中的数据孤岛难题,隐私保护机器学习被学术界与产业界公认为是一条可行之路。但由于隐私保护机器学习与传统机器学习并非同属一个技术生态,企业想要搭建隐私保护生态面临着性能差、易用性差、黑盒协议等诸多难题。

RealAI通过融合密码学、分布式等多个技术体系推出了RealSecure隐私保护机器学习平台(RSC),这是业内首款隐私保护AI编译器,首创以底层数据流图的视角揭示机器学习算法与对应分布式隐私保护算法的联系,同时将隐私保护算法公式表达向更细颗粒度解构至“算子”级别,通过算子组合将机器学习生态与隐私保护机器学习生态一脉打通,实现两大生态的一体化。

得益于底层编译级的能力,RSC具备三大优势:

● 性能强劲。借助密码学优化、AI算法优化等改进实现,模型训练相比某主流国产开源框架(最新版)性能提升约40倍,耗时从4小时40分钟缩减至6分钟。考虑到特征工程与自动调参环境,隐私保护下完成全流程建模,总耗时实现从日级别到小时级别的飞跃。

● 无感应用。实现机器学习生态与隐私保护机器学习生态的「一脉相承」,仅需要少量改动,可以通过自动转换完成机器学习算法平台框架与隐私保护机器学习平台框架的统一,数据科学家能够以与机器学习建模相同的方式使用隐私保护机器学习,易用性大幅提升。

● 安全透明。真正的隐私保护学习应用应该是白盒可验证的,所有底层执行的计算是可审计的,这样才能保证隐私保护学习平台

易用性与性能的颠覆性提升让RealSecure成为更快更容易应用到商业环境的「企业级」隐私保护机器学习平台。当传统方法通过堆人力来打通不同的数据源,RSC则能够实现“高速公路”级别的节点链接,支付、消费、税务、交通、司法、运营商等大数据能够更快更安全的互联互通,反欺诈、小微普惠、AI医疗等智慧决策真正得以落地。

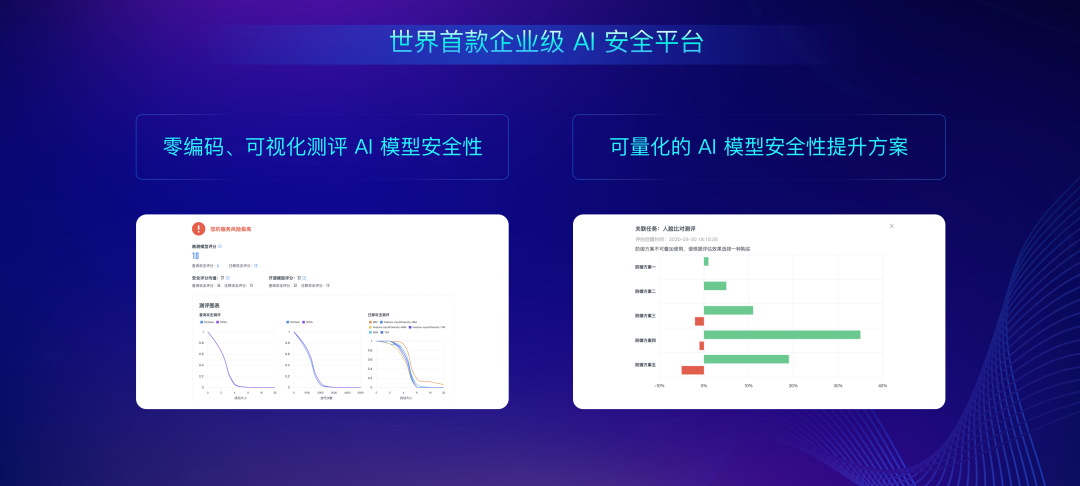

首个企业级人工智能安全平台RealSafe2.0

RealSafe是为解决人工智能安全隐患而生,它是世界首款商业化AI安全平台、业内首个针对人工智能模型的杀毒软件。

针对对抗样本、后门植入等攻击方式,RealSafe一方面能够对模型的安全性进行全面检测,且整个检测过程全界面化操作,用户无需具备专业的模型安全算法知识和编程开发经验;另一方面提供多种增强安全性的方案,并且可以自动化评估每种方案针对被测模型的安全性提升效果。

RealSafe2.0版本在前一版本基础上,安全检测能力进行了全面升级:首先是可评测的应用场景全面拓宽,从应用最广泛的人脸识别模型拓展到了目标检测、图像分类模型;同时,在检测抗对抗样本攻击的安全性基础上,新增针对图像分类模型的后门自动化检测。

「模型后门攻击」是一种新兴的针对机器学习模型的攻击方式,攻击者会在模型中埋藏后门,使得被感染的模型在一般情况下表现正常。但当后门触发器被激活时,模型的输出将变为攻击者预先设置的恶意目标。虽然目前这种攻击方式在实际场景中还不太常见,但针对可能存在的攻击对算法进行加固仍然具有重要意义。

除此之外,RealSafe2.0版本也提供了安全性提升方案,包括对抗样本去噪方法、对抗样本检测方法、对抗训练方法。

目前,RealSafe已在工信部重大建设项目以及某电网公司落地应用,未来将集成更多安全风险的检测能力,在此基础上,RealAI致力于打造第三方人工智能安全检测平台,探索无须人工干预地、自动化地训练出具有高安全性模型的技术方案。

打开人工智能产业“第二增长曲线”

「当在应用中碰到技术难题时,我们不是见一个解决一个,修修补补;而是发现一个问题就看到一类问题,并通过底层技术框架、平台的突破,助力产业的升级。今天我们重点发布的两款新品都是这一理念的典型代表,它们的产品定位、功能和价值都是独一无二,RealAI首创。」会上,田天阐明了公司定位的基本理念。

从底层技术到上层应用场景,RealAI打造的一系列AI原生基础设施打开了AI能力的全新维度,激发AI的第二增长曲线,为AI赋能各行各业带来全新市场机会。

比如:让金融场景在合规、隐私保护的前提下,显著提高智能风控、反欺诈、精准营销等应用的效果;使智慧理财产品风险可控,提高资产配置和利用效率;通过打造自主智能决策系统,帮助工业制造企业提高生产效率、降低成本提供更加安全、受保护的刷脸支付系统;帮助公共安全部门提高对各个渠道虚假内容的管控能力,防范相应传播风险等。

最后,田天表示道,RealAI的目标就是补全AI原生基础设施体系,提供服务于不同行业的业务产品和解决方案,使得所有场景不论大小、不论价值高低,都能够从AI赋能中受益,让AI更高质量的服务于人类社会。