人脸识别技术的普及极大的便利了我们的生活,但其安全问题一直为社会各界高度重视。

近日,RealAI安全算法团队发布了一项测试研究,通过一副特制眼镜攻破19款主流商用手机的人脸解锁系统。测试结果一经发出就引发了公众对人脸识别技术的质疑,人脸识别真的安全吗?

近年来,关于人脸识别被破解的话题频频被提及,打印的纸质照片、动态视频等都曾被作为攻击“道具”,针对这类假体攻击,目前业界已推出静默、近红外等适用于不同场景的活体检测方案,不少厂商的活体检测算法已经能够达到拒绝率99%,通过率99%的检测,相关的国标也都明确了人脸识别系统应搭载活体检测能力。那为什么这些人脸识别系统还这么容易被攻破呢?

一、算法局限衍生出的安全漏洞

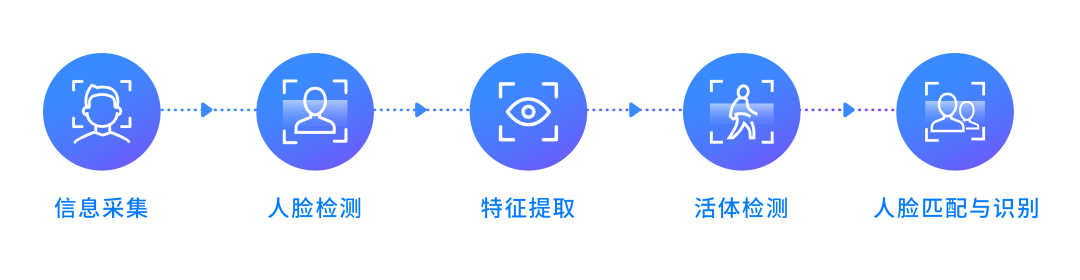

首先要明确,RealAI算法团队采用的对抗样本攻击与假体攻击本质上属于两大类完全不同的攻击方法。结合人脸识别主要技术环节来看,假体攻击与对抗样本攻击所属的范畴、攻击目标与实现手段存在明显的区分。

图:人脸识别主要技术环节(示意)

假体攻击对应的是活体检测环节,属于“伪造真脸”范畴,主要将攻击对象的人脸信息借助其他媒介呈现,比如纸质照片、电子产品的显示屏幕、硅胶面具、立体的 3D 人像等,“以假乱真”让系统误认为这是一张真实的人脸。不过随着活体检测的出现与技术的不断成熟,想要再实现“拿一张照片”就攻破人脸识别已不再容易。

对抗样本攻击主要对应的是人脸匹配与识别环节,属于对活体检测算法和人脸识别算法底层原理漏洞的攻击范畴。主流的活体检测和人脸识别模型主要基于深度学习方法训练得出,高度依赖数据样本导致其存在系统性的缺陷,容易被数据“蒙蔽”。对抗样本攻击就是运行环节的输入数据中设计添加扰动导致模型识别错误,比如RealAI做的手机测试,就是在物理空间攻击者真实的人脸(输入数据)上添加局部干扰信息(基于两者面部信息计算生成的对抗补丁),让人 脸识别模型将其错误识别为特定的攻击对象。

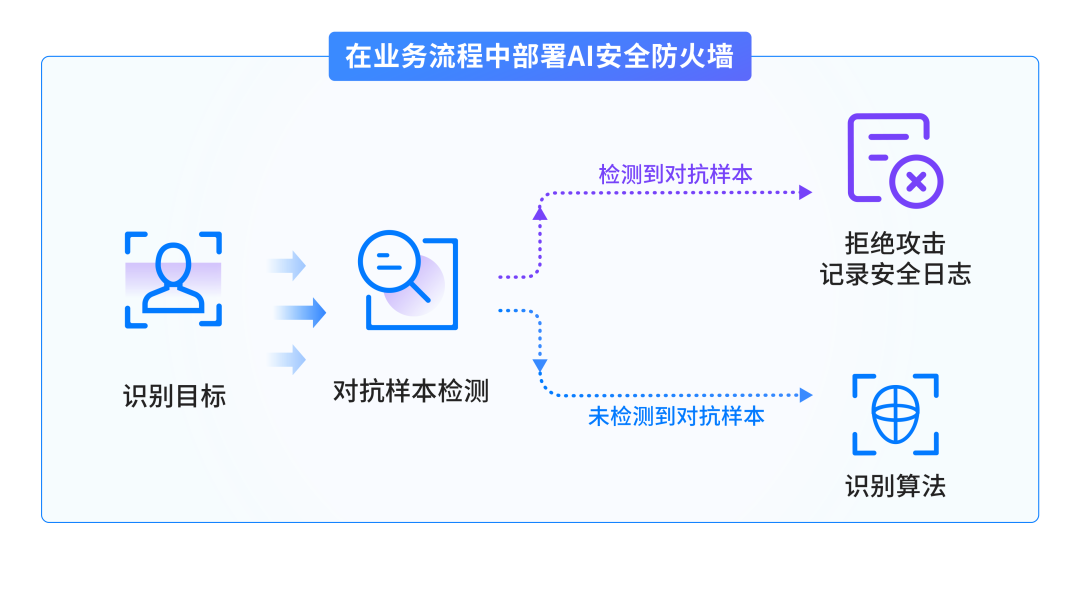

不同于假体攻击已经有成熟的应对方案,对抗样本攻击是一个全新问题,需要专业化的检测方法。瑞莱智慧RealAI团队推出的人工智能安全平台RealSafe,是业内首个提供模型安全性测评能力的平台,针对于目前人脸识别领域的对抗样本攻击,升级了对抗样本检测能力,支持检测识别目标是否佩戴了对抗补丁,能够有效抵御针对于人脸识别模型的物理世界对抗样本攻击。

二、应用级对抗样本攻击防火墙

对抗样本攻击的对象覆盖广泛,智能手机、通行闸机、应用APP、门禁考勤机等所有搭载人脸识别功能的应用和设备都存在被对抗样本攻击破解的可能。RealSafe平台新升级的对抗样本攻击防火墙是专门面向工业落地场景,兼容各种复杂场景下的识别模型。

● 持续可靠的对抗样本检测能力:RealAI孵化自清华大学人工智能研究院,核心团队长期深耕AI安全攻防方向,在相关领域已发表了数十顶会论文,获得了DEFCON、GeekPwn等世界顶级黑客大赛的多项冠军,检测能力可持续覆盖最新的攻击算法;

● 灵活的部署方式:针对于移动刷脸解锁、远程人脸身份认证等不同场景,平台提供的对抗样本检测能力可部署在手机端或服务器端上,在无网、有网环境下均可以稳定运行;

● 效果显著:对抗样本检测产品在各种光线、背景等复杂识别场景下已经达到了通过率99%、拒绝率99%的良好检测效果。

如果您对我们的对抗样本防火墙产品感兴趣,可通过邮箱 contact@realai.ai联系我们。