从“中国人脸识别第一案”到售楼处人脸识别“杀熟”,再到315曝光“海量人脸数据被滥用”,人脸识别一次次成为公众舆论的中心话题。作为率先从理论研究走向大规模应用的人工智能技术,凭借强大的数据采集和分析能力,人脸识别给社会带来了极大便利的同时,也衍生出了隐私侵犯、信息泄露等一系列全新命题。

人脸信息作为生物特征数据,具有唯一性、不可撤销,一旦泄漏将面临“终身风险”。这些泄漏的人脸数据可能流入黑市被低价贩卖给数据公司用作训练AI的“原材料”,也可能流入不法分子手中被用于实施诈骗,比如通过照片活化破解线上银行身份认证,甚至被二次加工用于换脸色情视频的制作等,极大威胁社会安全与社会信任。

图:央视3·15曝光人脸识别隐私问题

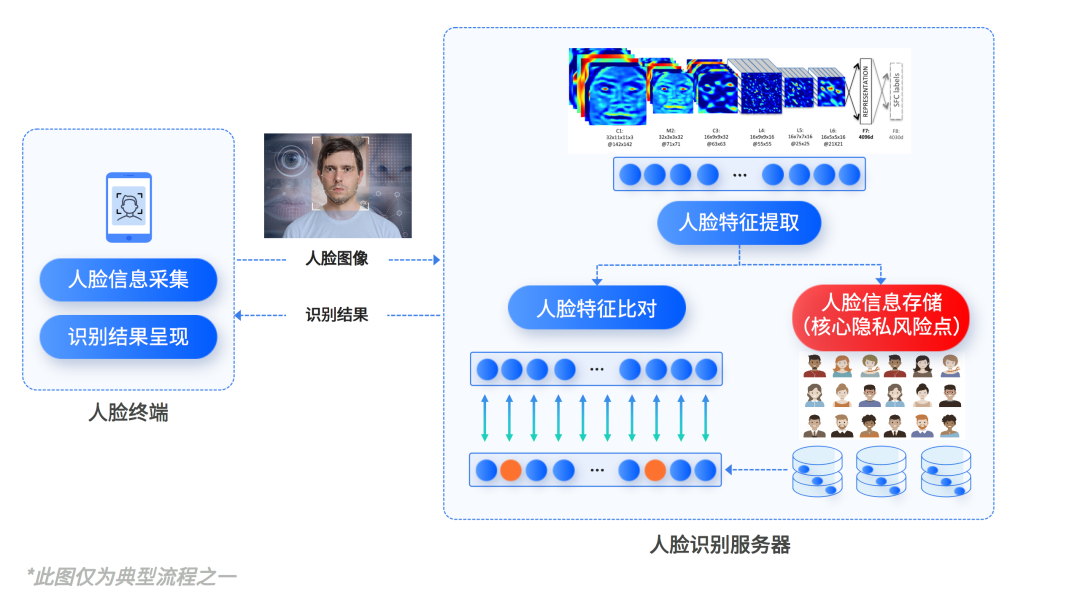

一、人脸隐私泄漏的主要风险环节

从技术原理来看,人脸识别系统的整个流程一般包括人脸图像采集、人脸图像数据预处理、人脸图像特征提取、人脸图像和特征存储、人脸特征匹配五个环节。在整个流程中,人脸数据需要上传存储至数据库,而这一环节往往是造成信息泄漏的主要风险点。

图:人脸识别流程解析

一方面是因为人脸数据是明文存储,即存储的人脸数据是未经脱敏或加密保护的原图,这就导致人脸信息可以被轻易地直接查看和复制;另一方面是因为中心化的存储方案,大量的人脸数据都被存储在各应用运营方或是技术提供方的中心化数据库,相当于把“鸡蛋放在一个篮子里”,一旦服务器被入侵或是被内部人员拷贝,高度敏感的人脸数据就会面临直接泄漏的风险。

二、隐私计算让人脸数据“安全”且“可用”

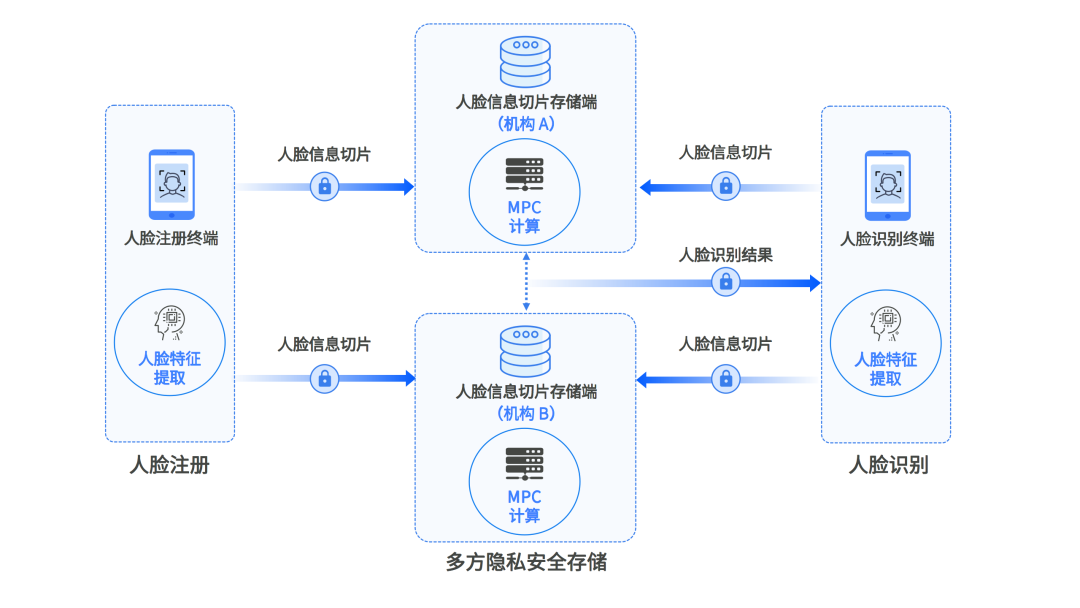

为了从根本上解决数据泄漏问题,瑞莱智慧RealAI联合清华大学人工智能研究院推出“基于隐私计算的人脸识别信息保护方案”,为人脸应用提供更安全的数据协作方式。

通过运用隐私计算技术,对人脸图像进行“去标识化”的加密处理和切片分布存储,保证任一存储方无法直接获取可识别出身份的人像数据。极端地,即便所有存储方共谋共享数据,也无法反向逆推出信息主体的原始图像或图像特征。因此,既保护了消费者的身份信息隐私,又合理保留了人像数据用于身份鉴别等应用的价值。

图:基于隐私计算的人脸识别信息保护方案

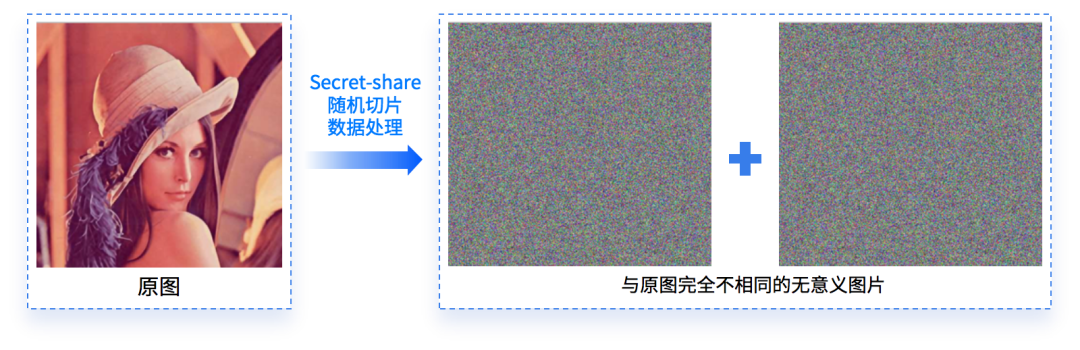

具体实现上,该方案采用秘密共享(secret-share)技术将提取的人脸特征数据进行随机切片,形成计算因子,并将计算因子经过通信信道加密处理后分别传输到不同计算节点(参与方)的业务处理系统并存储为人脸密文切片底库,避免图像原图存储于单独计算节点所带来的数据泄漏风险。

图:secret-share随机切片数据处理原理图示

身份验证时,同样再将采集到的人脸特征信息随机切片形成计算因子,并加密处理后分别上传至各计算节点,各计算节点接收到加密计算因子后进行解密还原,并与之前存储的密文切片进行目标匹配和识别,保证在不泄露各切片的原始信息基础上返回识别结果,有效保护用户的隐私信息安全。

除了分布存储与切片加密,该方案还具备两大安全性优势:一是通过对图像特征数据的所有传输环节进行加密,传输信道的加密可保证计算数据和计算过程不泄漏。二是通过同时定期更新人脸原始信息及人脸特征底库的加密种子,保证即使在各计算节点存在共谋泄露的情况下,只要人脸的原始信息、人脸的特征信息的加密方式未泄露,亦可保证数据安全。

在图像特征计算方面,该方案运用基于秘密分享的多方安全计算技术体系,保证用户图像特征在密文切片的形态下,以不牺牲算法模型准确率的情况下能够准确完成身份信息的验证,保障人脸数据在安全的前提下被高效使用。

伴随人脸识别的大规模应用,加强人脸隐私保护已迫在眉睫,“基于隐私计算的人脸识别信息保护方案”的提出则是从底层技术实现上为平衡隐私保护、技术便利和公共安全提供了最优解。