此前,Twitter正式发布一项政策,表示将于 3 月 5 日开始对平台上任何“明显且欺骗性地编辑或捏造”的照片和视频打上“虚假”警告标签,同时将删除任何可能造成伤害、蓄意误导的媒体内容,包括可能带来人身安全威胁、社会混乱、打压选民或隐私风险的内容。

虽然,Twitter并没有区分具体是基于哪类技术修改的媒体内容,但Deepfake显然在其列。2019年11月,Twitter就发布了首个反Deepfake策略草案,并面向公众征集意见,此次政策是征集意见后的确定方案。

过去一段时间里,Deepfake早已成为“虚假信息洪流”的中心话题,并一步步威胁到社交媒体平台的公信力,让诸多社交网络公司蒙受了不小的压力。

01

社交媒体平台公信力滑坡

事实上,目前各个社交媒体平台上都传播着大量Deepfake造假视频的误导性内容,传递虚假信息操纵公众舆论,甚至被用于勒索或者非法牟利,政治家、明星,甚至普通人都逐步成为“虚假信息洪流”的受害者。

其中,色情行业成为Deepfake传播最为肆虐的领域,阿姆斯特丹的网络安全公司Deeptrace Labs的一项研究显示,从2018年12月到2019年7月,网络上的Deepfake视频数量增加了一倍,96%是色情视频,且所有色情作品的主题都是女性。

在受众越来越偏好视觉化呈现方式的时代, Deepfake的出现以更高的冲击力与说服力为网络谣言提供了新的寄生土壤,引发社会危机、损害名誉的同时,也给提供传播机会的社交网络平台带来一定的负面影响。

尼葛洛庞帝曾形象地将网民称为“没有执照的电视台”。在当今“赋权于民”的新媒体时代,传统意义上的“受众”也成为信息的主要生产者和传播者,网络上任何个人都可以成为信息的发布源头,当然也有可能成为谣言的传播者。

2018年,中国青年报社社会调查中心联合问卷网,对2006名受访者进行的一项调查显示,87.7%的受访者在网上遇到过视频谣言。而Deepfake由于以假乱真的技术,加之视频本身比图片等媒介形式更具真实感这一特殊性,所以基于Deepfake生成的虚假视频内容更具误导性,蛊惑性也更强。

此外,聚焦公众热点、深谙人性黑暗面,Deepfake虚假视频更容易煽动公众情绪, 也更加充满了不可控性与不确定性, 成为威胁网络公共空间安全的一颗定时炸弹。“眼见未必为实,耳听未必为真”,这类虚假视频目前正以指数级的增长速度充斥各大社交媒体平台,社交媒体迎来严重的信任危机。

02

与AI造假视频的拉锯战

Deepfake技术使用的低门槛使得创建虚假信息变得更加容易,每一个人都可能成为虚假视频的主角,为此,很多研究机构开始了检测AI造假视频的研究,但随着Deepfake造假技术的不断演化,这场对抗赛最终演变成一场拉锯战。

最初Deepfake视频中人物眨眼方式存在漏洞,正常成年人的眨眼间隔为2秒到10秒,一次眨眼需要十分之一到十分之四秒,而多数Deepfake视频的人物无法做到这一点,为此能够通过观察眨眼间隔来判断视频真伪。然而随着闭眼图像数据与视频序列加入算法训练,Deepfake视频中的眨眼间隔得到改善,肉眼辨别视频真假的方式不再行得通。

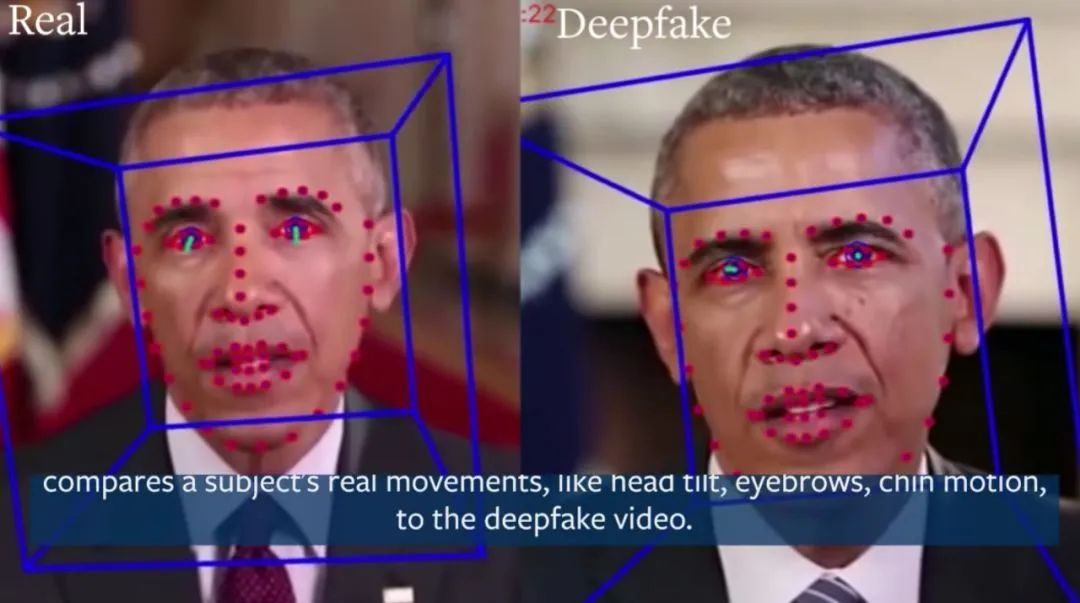

之后又出现了基于能够模仿源语音和手势的模仿器制作的伪造视频,视频中的人物形象动作更加接近真实。比如2018年BuzzFeeD通过FakeApp工具将喜剧演员JorDan Peele嘴巴“搬家”到奥巴马的脸上,再将奥巴马的下巴换成一个可以随着演员嘴部动作一同运动的下巴,经过56个小时的训练,Peele的嘴部动作和奥巴马的脸自然融合。

虽然这段视频当时通过肉眼仍然能够看出来嘴巴不够自然,然而之后不到一年的时间内,华盛顿大学的计算机科学家就使用神经网络AI对奥巴马的嘴巴进行建模,并使其与音频输入进行口型同步,真正做到了几可乱真。

近年来,Deepfake技术不断发展,所生成的图像与视频越来越逼真,大大增加了判断视频真伪的难度。而在商业环境下,比如社交媒体平台针对Deepfake视频内容的检测,由于内容复杂、覆盖面广,并且缺乏有效的检测工具,识别难度更高。

03

社交媒体平台对Deepfake的反击

Deepfake虚假视频的传播、扩散,使得社交媒体平台公信力下滑,这也促使国内外的不少社交网络公司开始反击,推出了一系列治理举措,对Deepfake视频造成的紧急威胁做出有力应对。

●2019年10月,Facebook宣布启动“Deepfake视频检测挑战赛”,壕掷1000万美元,悬赏能够最好地检测出利用Deepfake技术制造的假视频,包括微软、MIT、牛津大学,加州大学伯克利分校等业界学界联合支持;

● 2020 年 1 月 ,Facebook 承诺在2020年美国总统大选之前,遏制Deepfakes的误导性信息问题,Facebook 全球政策管理副总裁 Monika Bickert 在博客中表示,Facebook 将删除平台上 “深度学习”和其他形式的伪造视频;

● 2020年1月,字节跳动旗下短视频分享应用TikTok(抖音海外版),发布了一项广泛禁令,禁止可能对其社区或公众造成伤害的“误导性信息”;

● 2020年2月,Alphabet旗下子公司YouTube表示,将删除任何经过技术修改,并可能构成“严重伤害风险”的内容。

作为承载内容的传播渠道,社交媒体平台应充当好“把关人”的角色,加强对传播内容的审核, 对于视频的真实性应进行更深入细致的规范管理。从长期来看,各平台应当设立更加完善的内容审核制度,对Deepfake虚假内容进行针对性检测,对平台内容进行长期、高效的净化。

不过目前Deepfake技术日新月异,检测手段的技术门槛较高,也缺乏相关技术人才,如果社交媒体机构仅依靠自身,需要花费较高的人力与时间成本,因此需要和一些专业机构联合,另辟蹊径,运用先进的技术工具来提高自身的“把关”水平。

此外,社交媒体平台作为链接媒体与公众的桥梁,也有义务培养新闻工作者提高对Deepfake虚假信息的敏感意识,避免虚假信息源被错误滥用,事实上有些平台已经开展了相关工作。

2019年,Facebook斥资六位数帮助路透社创建了有关识别Deepfake的在线课程,据悉这门免费的网络课程叫做“Identifying and Tackling Manipulated Media”(识别和处理操纵的媒体),旨在帮助全球的新闻工作者学习如何识别经过修改的具有不准确信息的照片或视频。进入2020年,两者还将共同主办与该主题相关的活动和小组讨论,旨在辅助媒体行业提高鉴别Deepfake视频的能力。

2月5日,Alphabet 子公司 Jigsaw 也公布了一款名为 “Assembler” 的工具,可以帮助媒体记者更轻松地发现 Deepfake与经过篡改的图像。据悉,这款工具运用 “探测器”来分析图像或 Deepfake伪造内容,以确定内容是否真实,如果不真实,使用者会被告知图像可能在哪些地方遭到了篡改。

就如国际著名防毒软件公司Avast表示:未来将会有更多的“ DeepAttacks”。未来几年中,Deepfake可能带来更多新型的、隐秘的内容威胁,对于媒体机构而言,这无疑是一把“达摩克里斯之剑”。

面对Deepfake带来的“虚假信息洪流”,社交媒体平台应当积极应对,运用先进的技术能力,提高“把关人”水平,从而维护自身公信力,维护网络空间安全。

扫码体验Deepfake内容检测工具